Google ha un'enorme operazione di apprendimento automatico, quindi non sorprende che l'azienda lo applichi a ogni dato che gli forniamo, ma c'è qualcosa nel rovinare le nostre foto che sembra trasgressivo, qualunque sia il sorriso che Google prova. mettilo su. Ci sono state molte cose nel keynote di Google I/O 2021 che hanno colpito una nota strana, come celebrare i suoi "principi dell'IA" dopo essersi rivolto al suo ex etico dell'IA, il dottor Timnit Gebru, che ha portato l'azienda a guidare i suoi scienziati. "Sii più positivo" sull'IA. Ma è stata la parte del discorso programmatico di Shimrit Ben-Yair, direttore di Google Foto, a essere particolarmente sconvolgente. Durante la sua presentazione, ha mostrato in che modo la tecnologia di apprendimento automatico di Google è stata in grado di analizzare tutte le tue foto, identificare somiglianze meno riconoscibili nell'intera raccolta di foto e raggruppare le tue foto di conseguenza.

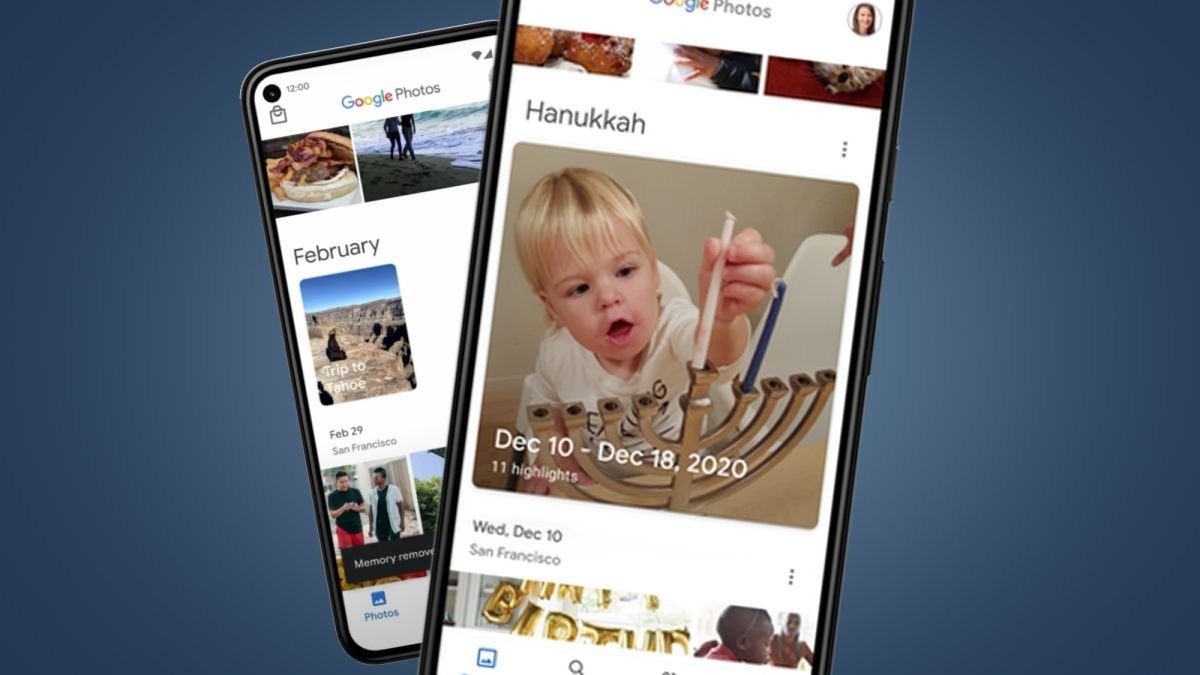

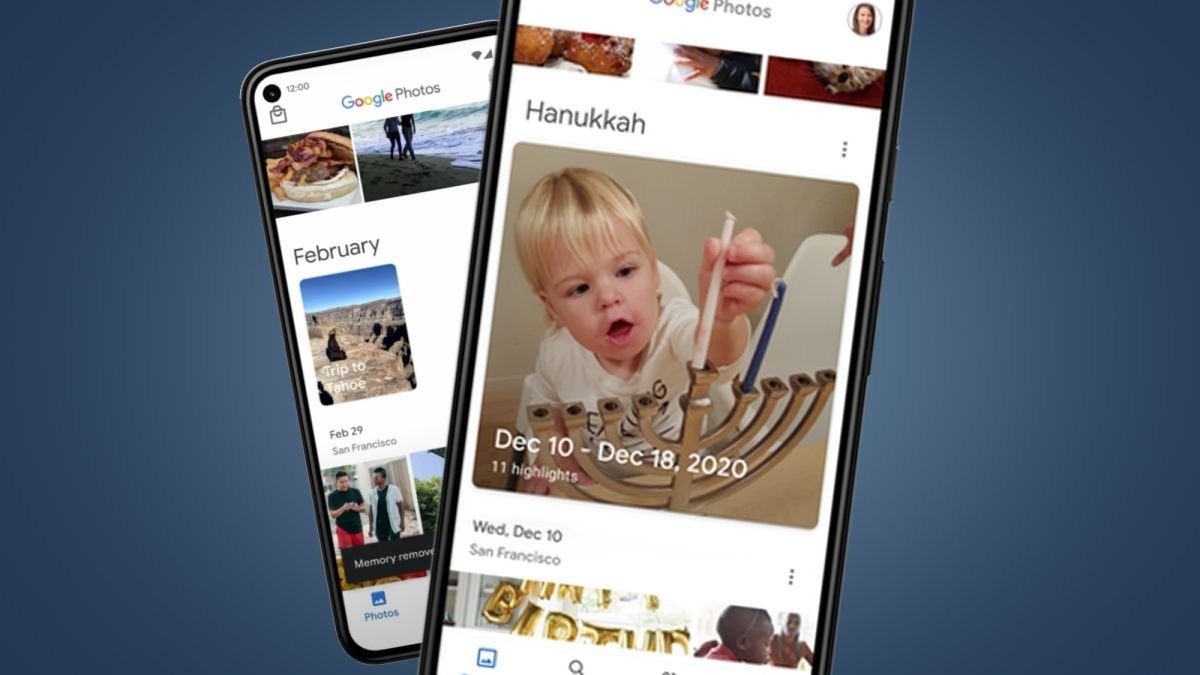

(Credito immagine: Google) Vale a dire, Google esegue ogni foto che gli dai attraverso algoritmi di apprendimento automatico molto specifici e identifica dettagli molto specifici della tua vita, come il fatto che ti piace viaggiare per il mondo con una borsa. , Per esempio. Fortunatamente, Google almeno riconosce che ciò potrebbe essere problematico se, ad esempio, sei transgender e l'algoritmo di Google decide di voler creare una raccolta di foto pre-transizione. Google comprende che questo potrebbe essere doloroso per te, quindi hai la possibilità completa di rimuovere la foto incriminata dalle raccolte in futuro. Puoi anche chiedere loro di rimuovere qualsiasi foto scattata in una data specifica che potrebbe essere dolorosa, come il giorno in cui è morta una persona cara. Tutto questo è meglio che non avere affatto questa opzione, ma l'onere è ancora su di te, l'utente, che lo è sempre, lo è sempre. Qual è un problema per alcuni quando Google ha nuove funzionalità da implementare che nessuno stava chiedendo? Quindi arriviamo alla parte della presentazione in cui Google prende una selezione di due o tre foto scattate insieme, come quando scatti molte foto di fila per catturarne una in cui nessuno sbatte le palpebre in una foto di gruppo, e applica la sua apprendimento automatico per generare una piccola "foto cinematografica" con loro. Questa funzione, introdotta per la prima volta a dicembre 2020, utilizzerà l'apprendimento automatico per inserire cornici completamente fabbricate tra queste foto per generare essenzialmente una GIF, ricreando un evento dal vivo in un modo che sia un facsimile dell'evento così come è accaduto. Enfasi sull'invio di fax.

(Credito immagine: Google) Google lo presenta come un aiuto per ricordare vecchie foto, ma non è quello che è, è l'inizio della fine della reminiscenza come la conosciamo. Perché fidarsi della tua memoria quando Google può generarne solo una per te? Non importa se crei una registrazione di qualcosa che non è realmente accaduto e te lo presenti come se fosse accaduto. Certo, i tuoi occhi potrebbero aver tremolato "qualcosa del genere" tra quelle due foto e non è che Google ti stesse costringendo a fare battute di coca a una festa quando non ne stavi facendo una, così e così. Ma quando si tratta di ciò che è etico e di ciò che non lo è, non c'è posto per il "genere". Questi sono i tipi di scelte che ci portano su percorsi che non vogliamo intraprendere, e ogni passo su un percorso ci rende più difficile tornare indietro. Se c'è una cosa che avremmo davvero dovuto imparare negli ultimi dieci anni, è non avere una fede così cieca negli algoritmi di apprendimento automatico che hanno il potere di distorcere la nostra percezione della realtà scientifica. QAnon è un prodotto di apprendimento automatico tanto quanto Netflix, ma ora metteremo i nostri album fotografici sull'altare dell'intelligenza artificiale e chiameremo tutto ciò che viene fuori "Ricordi". Nel frattempo, molta energia reale viene spesa per eseguire tutti questi algoritmi nei data center mentre il cambiamento climatico progredisce. Con ogni nuovo avanzamento della piattaforma di apprendimento automatico di Google, diventa sempre più evidente che dovresti davvero ascoltare ciò che esperti di etica come il Dr. Gebru stanno cercando di dirti, e diventa ancora più ovvio che non sei interessato a farlo.